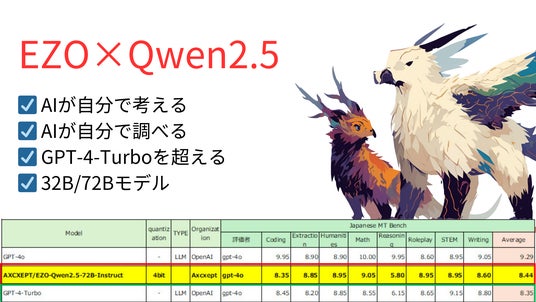

Axcxept株式会社(本社:北海道札幌市)は、本日、GPT-4-Turboを凌ぐ性能を持つ新たな日本語大規模言語モデル(LLM: Large Language Model)「EZOシリーズ」の4モデルをローンチしました。Qwen2.5をベースに開発されたこの新シリーズは、日本語処理能力において高い評価を受けています。

GPT-4-Turboを凌ぐ卓越した性能

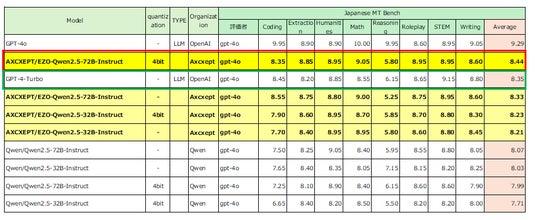

EZOシリーズの72Bパラメータモデル(4bit量子化版)は、国内で著名な日本語評価指標Japanese MT Benchにおいて、OpenAI社のGPT-4-Turboを上回る性能を達成しました。この評価は、GPT-4oを用いた自動評価によるものです。

本ベンチマークは、Auto-CoT-RAGを利用していないモデルのベンチマークです。Japanese MT Benchは、160問の様々な日本語タスクをAIに回答させ、その回答を、評価者となるより優秀とされている別のAIに評価させるという仕組みです。あくまで一定の指標に基づく店及び、自動評価のため偏り・ブレがあることにご注意ください。

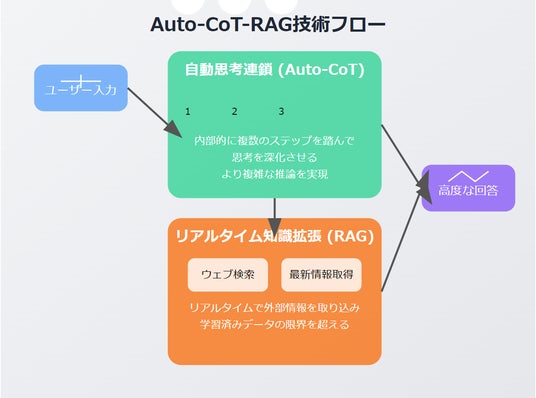

Auto-CoT-RAG技術の搭載

32Bおよび72Bモデルにはカスタムプログラムである、Auto-CoT-RAG(Automatic Chain of Thought with Real-time Augmented Generation)技術を実装したモデルも併せてリリースいたします。システムとして組み込むことの多い、インターネット検索結果を内包した仕組みを提供するほか、内部処理にて思考の連鎖処理を実現しています。これはLLM×プログラムというスタイルの手法です。

- 自動思考連鎖(Auto-CoT):内部的に複数のステップを踏んで思考を深化させ、より複雑な推論を可能にします。

- リアルタイム知識拡張(RAG):学習済みデータの限界を超え、リアルタイムでウェブ検索を行い最新の情報を取り込むことができます。

多様なモデルラインナップ

EZOシリーズは、7B、8B、9B、32B、72Bなど、多種多様なベースモデルをチューニング氏、様々な用途や計算リソースに対応します。特に32Bと72Bモデルは、Auto-CoT-RAG技術により、GPT-4-Turboを凌ぐ性能と柔軟性を提供します。

モデルリリースページ:

<Auto-CoT-RAGなし>

32B:https://huggingface.co/AXCXEPT/EZO-Qwen2.5-32B-Instruct

72B:https://huggingface.co/AXCXEPT/EZO-Qwen2.5-72B-Instruct

<Auto-CoT-RAGあり>

32B:https://huggingface.co/AXCXEPT/EZO-AutoCoTRAG-Qwen2.5-32B-Instruct

72B(4bit量子化済み):https://huggingface.co/AXCXEPT/EZO-AutoCoTRAG-Qwen2.5-72B-Instruct_q4

社会的意義とビジョン

EZOシリーズの開発は、日本のAI活用を加速し、技術革新を通じて社会に貢献することを目指しています。この取り組みは、クラウドファンディングを通じて多くの支援者の方々に支えられており、特にスタートダッシュを盛り上げてくださった、システム生成AI「Babel」の開発者、Motoki様をはじめとする支援者の皆様に深く感謝申し上げます。

また、この開発は、Google社、Meta社、Alibaba Cloud社といった企業による優れたベースモデルの提供、そして先駆的な技術文献を公開してくださっている多くの方々のご協力に支えられています。ここに、改めて深く感謝申し上げます。

システム開発におけるソースコード全体をAIで管理するツール「K??doInsight」

Axcxeptは、現在LLMの開発だけでなく、新たなサービスを開発しています。開発途中のこのシステムは、プログラマーやシステム開発を行う様々なレイヤーの作業を支援し、本来注目すべきことに集中できる包括的なシステム開発ソリューションを提供する予定です。

今後の展開

Axcxept社は、以下の取り組みを計画しています:

- EZOシリーズ開発を用いた発展:大学・研究機関との共同研究プロジェクトの拡大

- 宇宙産業への軽量AIの適用

- LLM開発にて習得した研究開発の経験をいかしたIT業界における革新的なソリューションの創出

- ITエンジニア向けの痒い所に手が届くサービス開発

補足説明

- LLM(Large Language Model):大規模な言語データを学習し、人間のような自然言語処理能力を持つAIモデル。

- GPT-4-Turbo:OpenAI社が開発した最新の大規模言語モデル。

- Japanese MT Bench:日本語の自然言語処理能力を評価するベンチマーク。

- 4bit量子化:モデルのパラメータを4ビットで表現することで、メモリ使用量を削減する技術。

- Auto-CoT-RAG(Automatic Chain of Thought with Real-time Augmented Generation):自動思考連鎖とリアルタイム知識拡張を組み合わせた技術。

会社情報:

Axcxept株式会社

代表:Kazuya Hodatsu

HP:https://axcxept.com

所在地:札幌市白石区東札幌5-1-1-1 札幌市産業振興センター

事業内容:AI言語モデルの開発・提供、AIシステム開発、LLM研究、Webサイト制作、

クラウド基盤構築 ほか

Axcxept社は、北海道から日本のAI革命を牽引し、技術革新を通じて社会に貢献することを目指しています。

【本件に関するお問い合わせ】

Axcxept株式会社

担当:代表 Kazuya Hodatsu

Email:info@axcxept.com

X:@hokazuya(ホーダチ)[https://x.com/hokazuya]